马上注册,下载更多AI资源软件

您需要 登录 才可以下载或查看,没有账号?立即注册

×

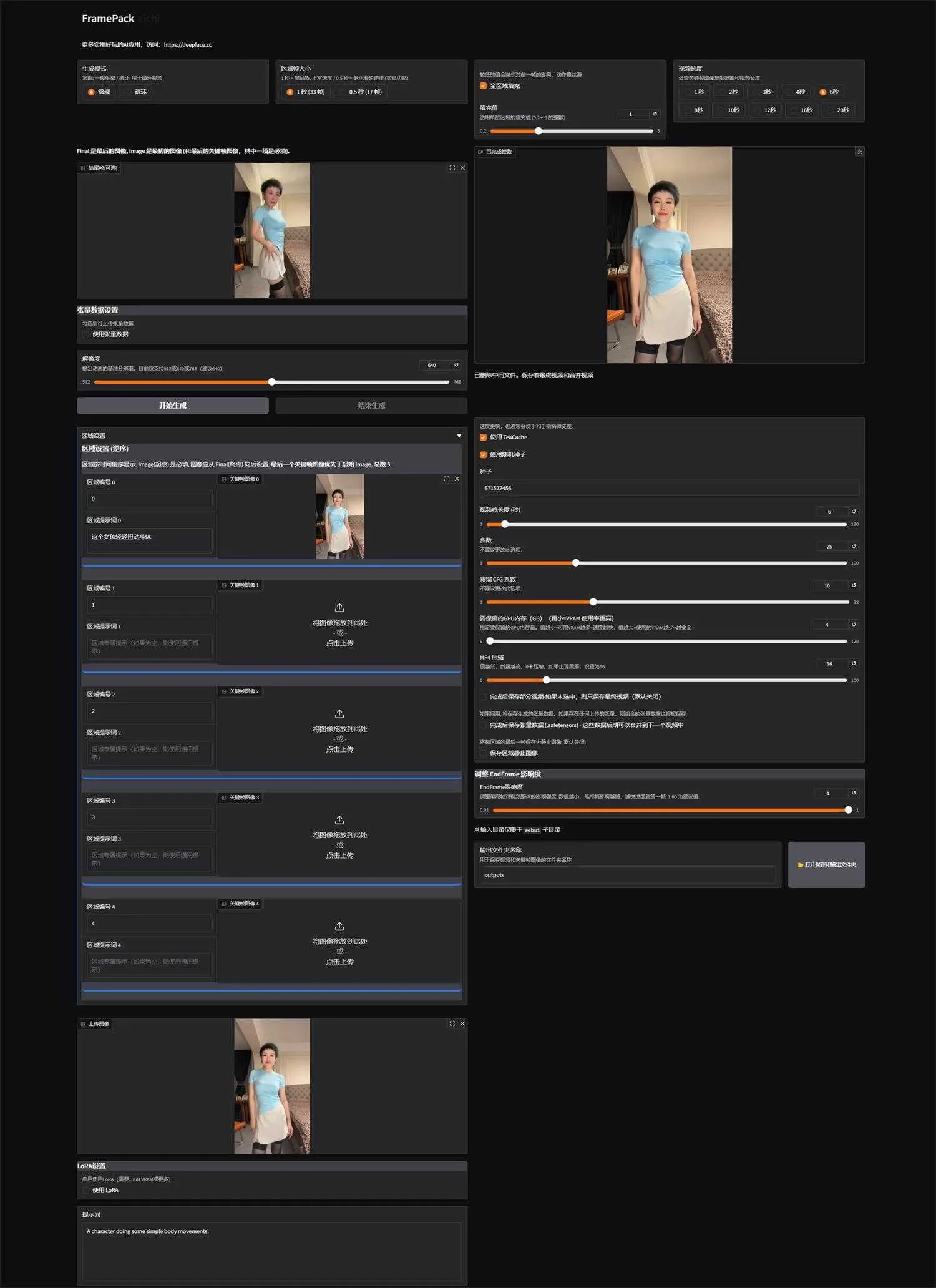

FramePack-eichi - FramePack 增强版,一个功能强大的AI视频生成工具 本地一键整合包下载 ... ... ... ... ...

FramePack-eichi 是一个FramePack 的分支版,由日本技术爱好者在FramePack 的基础上,整合了多个分支,汇总了这个增强版。新增循环视频生成;支持LoRA,LoRA 应用的稳定性和一致性得到提升;新增视频长度设置及视频分辨率设置功能;新增多节支持,可在多个节中指定关键帧图像,每节可以单独设置提示词,实现复杂的动画视频生成;新增张量数据的保存与合并,保存视频的潜在表达并可实现多个视频的合并等。

FramePack 是斯坦福大学主导开发的视频生成框架,是一种用于视频生成的下一帧(下一帧部分)预测神经网络结构,可以逐步生成视频。FramePack 主要开发者之一,就是业内大名鼎鼎的张吕敏大佬,AI领域的“赛博佛祖”,ControlNet的作者,站内也发布了他的很多项目一键包。

FramePack 的最大亮点在于其极低的硬件门槛。传统视频扩散模型通常需要高昂的显存支持,而FramePack 仅需6GB显存 即可实现全帧率(30fps)下上千帧的视频扩散生成。这一特性使得普通消费级GPU也能轻松运行复杂的视频生成任务,极大降低了技术应用的门槛。在RTX 4090上,单帧生成速度1.5秒(优化后),生成1分钟视频(1800帧)不到1小时,效率碾压同类技术。

FramePack 基于腾讯的hunyuanvideo,只需要上传一张照片,输入提示词,即可生成对应的视频。应该是目前生成效果兼顾资源占用最优的开源视频生成项目,尤其是人物视频生成,效果堪称业界翘首,AI视频生成平民化即将由此拉开序幕。

FramePack-eichi主要功能:

多语言支持(i18n):支持日语、英语、繁体中文的 UI(我在原版基础上新增了简体中文,默认加载简体)

高质量视频生成:从单张图片生成自然动作的视频

灵活的视频长度设置:适用于 1-20 秒的各个段落模式

节帧大小设置:可切换 0.5 秒模式与 1 秒模式

全部填充功能:所有节都可以使用相同的填充值

多节支持:可在多个节中指定关键帧图像,实现复杂的动画

每节单独的提示设置:可为每个节指定单独的提示

张量数据的保存与合并: 保存视频的潜在表达并可实现多个视频的合并

提示管理功能: 提示的保存、编辑和重复使用变得简单

MP4 压缩设置: 可调整视频的文件大小与画质之间的平衡

【测试中】 hunyuan LoRA 支持:通过模型定制添加独特的表达方式

日志功能:提供详细的进度信息,在结束时输出处理时间,Windows 系统还会发出声音等

使用教程:(建议N卡,显存8G起,内存RAM建议32G起。基于CUDA12.6,暂不支持20系及以下显卡)

上传图片,输入提示词,生成即可。

支持首位帧生成,上传一张开始帧,一张结束帧,输入提示词,生成即可。

虽然显卡要求门槛低,但部分硬件占用会转移到内存RAM上,所以建议低显存显卡用户需要有足够的内存,建议内存32G起

支持多节(区域生成),类似V4版时间戳功能,但这个版本更加丰富,不仅支持首尾关键帧生成,还支持中间插入多个帧,每个帧支持不同的提示词生成。

需要使用该功能,点击“区域设置”板块,展开详细设置,上传需要插入的帧,输入提示词。以此类推,支持多张帧插入

同时支持填充和指定生成时间设置

所有参数设置完成后,点击生成即可。

类似视频生成,如果想要速度和质量并存,显卡还是硬性条件, 建议尽量显卡不要太差。所以消费级显卡只能勉强体验,速度和质量都不会太高。

下载地址:

迅雷云盘:https://pan.xunlei.com/s/VOSNqTm_t7iRRtoBqt9oEeyoA1?pwd=gsmp (默认不包含模型,首次运行会自动下载,模型较大,请等待下载完成。下载过上个版本的用户,只需要将hf_download目录拷贝到V2版目录下即可)

百度网盘:🔒付费内容 游客, 上上宾会员 可免费下载该资源, 点此开通上上宾 免费下载全站99%的付费资源。或单独支付 20碎银 下载该资源

解压密码:https://deepface.cc/ 复制这个完整的网址即是解压密码,不要有空格,复制粘贴即可

|