马上注册,下载更多AI资源软件

您需要 登录 才可以下载或查看,没有账号?立即注册

×

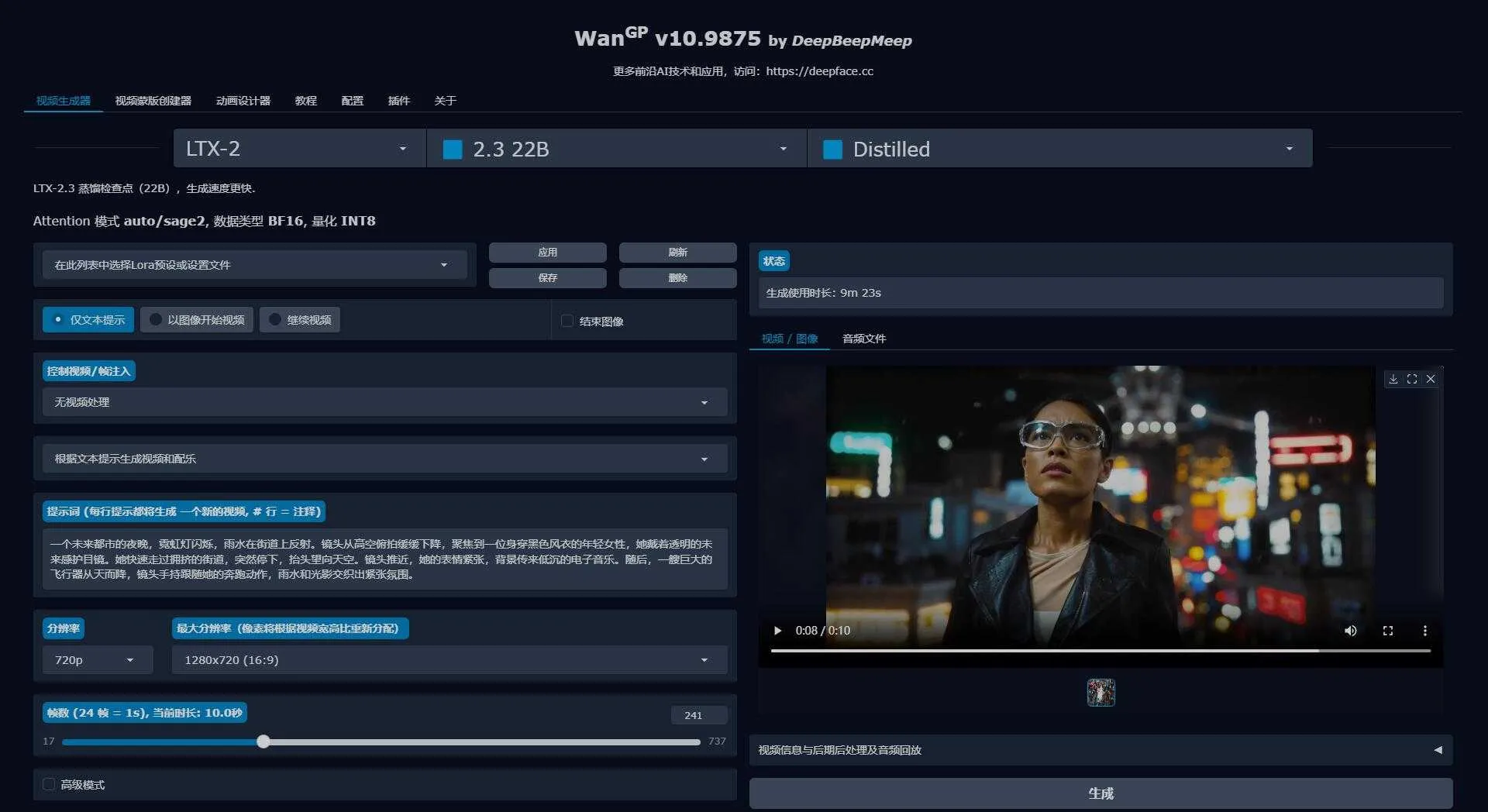

Wan2GP V40版 - 新增Qwen3.5VL 低配显卡玩转AI绘画/视频生成/音乐语音 支持50系显卡 一键整 ... ... ... .. ...

Wan2GP 是一个由DeepBeepMeep开发开源的 “显卡门槛低的全能型 AI 创作工具”,最大的特点是“低显存也能跑”,支持多种模型(视频、图像、语音、音乐),旨在为GPU资源有限的用户提供高质量的 视频/绘画 生成体验。它囊括了多种绘画/视频生成模型,包括阿里的Wan及其衍生模型、腾讯的Hunyuan Video和LTV Video等主流视频生成和Qwen-Image-Edit、Flux、Z-Image等模型,通过简洁易用的网页界面,用户无需深入了解复杂的模型细节,即可轻松生成想要的 绘画/视频内容。

Wan2GP 的问世,让广大低端显卡用户也能玩转高大上的视频生成项目了。就以HunyuanVideo 13B图生视频模型来说,原版需要至少80G显存才能跑得动的模型,现在 Wan2GP 把这个标准降低到10GB,而且生成的视频质量几乎没用任何的损失和降低。但缺点也是有的,生成时间会拉长,同时需要更大的运行内存。

Wan2GP 同时支持各种主流高质量的AI绘画和图像编辑模型以及语音和音乐生成模型,目前支持Flux和Qwen主流图像生成和图像编辑模型、Qwen-TTS和Index-TTS等主流语音模型、Ace-Step等音乐生成模型,涵盖视频生成、图像生成、语音音乐等综合领域All In One。

今天分享的 Wan2GP V40版,基于官方 3月17日的 V10.9875 打包。新增 WanGP API;新增 Qwen3.5VL提示增强器;新增 LTX2.3控制视频支持(Ic lora 联合控制)将允许你在新视频中传输人体动作、边缘等;新增 LTX2.3 帧注入功能;更新LTX-2.3 空间上采样器以及多个功能优化等。

因后期版本整体做了模块化及大量内部重构,翻译的工作量难度也相应增大,翻译后的版本可能有一些问题, 如有影响使用的问题,请评论区回复,会第一时间修复。

在尽量保证功能完整的情况下,进一步对WebUI做了更多的汉化翻译,目前汉化率97%。新增“多开”功能,支持一次开启多个WebUI。

注. 从V6版到V39版,提供两种版本,免费版和付费版。区别为:免费版不再提供中文翻译,原汁原味官方原版,不包含模型;付费版为中文翻译版,包含一些常用的模型,后期会逐步加入更多模型,以及一些优化功能加入。

因个人精力优先,故从V40版起,不再发布任何免费版本的Wan2GP一键包。如需免费版,请移步历史版本。

3月17日更新内容

环境部分:

优化Wan Pytorch 编译器,恢复稳定的环境 torch到2.7;更新 SageAttention;集成Git环境,无需手动安装Git即可实现插件安装配置

因官方已支持 Python 3.11、Pytorch 2.10、Cuda 13组合,对Blackwell架构显卡做了大量优化和性能提升,后期版本考虑单独制作一个基于Blackwell架构(50系显卡)版的Wan2GP。

主要更新内容:

Qwen3.5 VL:基于刚刚发布的广受赞誉的 Qwen3.5 模型,新的提示增强器选择

LTX2.3 改进:仅提供结束帧,不提供开始帧:你知道你的故事如何结束,但想看看它是如何开始的,只需提供一个结束帧(无需开始帧)

多帧注入:可选择将参考帧注入到不同位置

新空间上采样器 1.1,补丁预计将提高长视频质量

WanGP API:各位开发者(或代理)请欢呼!WanGP 现在提供了一个内部 API,允许您将 WanGP 用作应用程序的后端。这需要遵守 WanGP 许可条款,并特别告知您的应用程序用户 WanGP 在后台运行。

mp4 中的新音频输出格式:视频文件中存储的音频现在可以是更高质量(AAC192 - AAC320)或 ALAC(无损)。请注意,您将无法直接在网页应用中收听 ALAC 音频轨道。

项目特点

低显存要求:只需 6GB 显存即可运行部分模型,适合“显卡贫民”(老款 NVIDIA RTX 10xx/20xx)。

多模型支持:兼容 Wan 2.1/2.2、Hunyuan Video、Flux、Qwen Image、LTX Video、Kandinsky 等主流开源生成模型。

多模态功能:不仅能生成视频,还支持图像编辑、语音合成(TTS)、音乐生成。

插件生态:内置画廊浏览器、模型管理器、CivitAI 下载器、Upscaler 等工具,方便扩展。

易用性:提供完整的网页界面和命令行模式,支持队列生成和批处理。

优化性能:支持量化(int8、fp8、NV FP4 等),提升速度同时降低显存占用。

应用领域

短视频创作:快速生成 AI 视频,用于社交媒体内容、广告或创意展示。

语音合成与配音:支持情感化 TTS,可生成多角色对话,适合播客、虚拟主播。

音乐生成:内置 Ace Step、Heart Mula 等模型,可自动生成歌曲和歌词。

学术研究与实验:为研究人员提供多模态生成平台,方便测试不同模型。

个性化创作:支持 Lora 微调和控制视频生成参数,满足定制化需求。

使用教程:(建议N卡,显存8G起,内存32G起。支持50系显卡,基于CUDA12.8)

使用和之前发布的Wan2.1以及类似的视频生成软件类似,根据需要,点击最上方的模型列表,切换需要使用的模型,会根据切换的模型自动下载,模型较大,耐心等待下载完成。

注. 模型是通用的,更新新版后,只需要将之前旧版的模型目录(目录下的ckpts)移动到新软件目录下即可,无需重复下载

支持文生视频和图生视频。支持低端显卡运行阿里Wan、腾讯HunyuanVideo以及LTV Video等高精度模型。支持多种Lora类型扩展,请根据页面使用说明将lora模型放入对应的目录手动加载。

启动WebUI后,页面有“指南”选项卡,作者很详细的介绍了不同的模型参数和特点及应用领域、Lora模型的加载及使用以及VACE ControlNet的详细使用说明。UI我也做了大部分汉化,方便大家使用。

基于原版使用文档,我做了详细的翻译,建议大家仔细阅读,作为操作参考。

测试了30-50系显卡,均能正常运行。10-20没做测试,可自行测试

Wan2.2 提示词填写技巧,可以参考官方文档:

https://mp.weixin.qq.com/s/ucHuyomTZ6X2q_tL3wHQQg

https://alidocs.dingtalk.com/i/nodes/jb9Y4gmKWrx9eo4dCql9LlbYJGXn6lpz

软件目录结构:

📂 ckpts/

│ ├── 📂 chinese-wav2vec2-base/

│ │ └── pytorch_model.bin

│ ├── 📂 Qwen2.5-VL-7B-Instruct/

│ │ └── Qwen2.5-VL-7B-Instruct_quanto_bf16_int8.safetensors

│ └── 📂 umt5-xxl/

│ └── models_t5_umt5-xxl-enc-quanto_int8.safetensors

📂 models/

│ ├── 📂 qwen/

│ ├── 📂 wan/

│ ...

📂 deepface/

......

下载地址:

夸克网盘:

🔒付费内容 游客, 上上宾会员 可免费下载该资源, 点此开通上上宾 免费下载全站99%的付费资源。或单独支付 99碎银 下载该资源

百度网盘:

🔒付费内容 游客, 上上宾会员 可免费下载该资源, 点此开通上上宾 免费下载全站99%的付费资源。或单独支付 99碎银 下载该资源

|